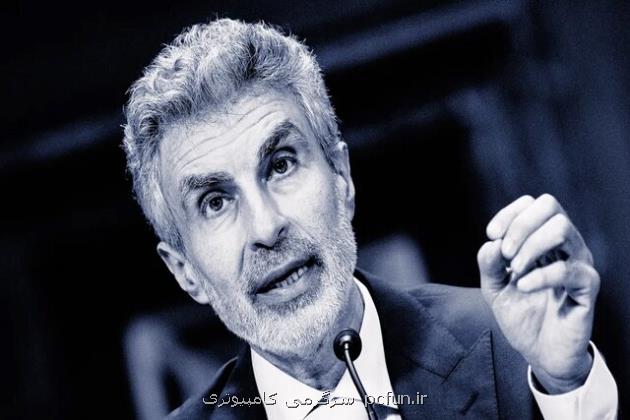

پدرخوانده هوش مصنوعی به کمپین مقابله با فجایع این فناوری پیوست

به گزارش سرگرمی کامپیوتری، یوشوا بنجیو که یکی از پدرخوانده های هوش مصنوعی به حساب می آید، به پروژه ای در بریتانیا برای پیشگیری از فجایع هوش مصنوعی پیوسته است. این برنده جایزه تورینگ اعتقاد دارد تنها راه تضمین ایمنی هوش مصنوعی، استفاده از نه انسان، بلکه همین فناوری جهت بررسی سایر سیستم های هوش مصنوعی است.

به گزارش سرگرمی کامپیوتری به نقل از ایسنا، یوشوا بنجیو برنده جایزه تورینگ که یکی از پدرخوانده های هوش مصنوعی مدرن به حساب می آید، روی پروژه ای که توسط دولت بریتانیا برای تعبیه مکانیسم های ایمنی در سیستم های هوش مصنوعی تعریف شده است، پیوسته است.

به نقل از نشریه موسسه MIT هدف این پروژه که Safeguarded AI نام دارد و به مفهوم «هوش مصنوعی محافظت شده» است، ساخت یک سیستم هوش مصنوعی است که بتواند بررسی کند که آیا سایر سیستم های هوش مصنوعی مستقر در مناطق حیاتی ایمن هستند یا خیر.

بنجیو بعنوان مدیر علمی به این پروژه ملحق می شود و مشاوره های انتقادی و سفارش های علمی را عرضه می دهد. این پروژه که طی چهار سال آینده ۵۹ میلیون پوند اعتبار دریافت خواهد کرد، توسط آژانس تحقیقات و اختراعات پیشرفته بریتانیا(ARIA) تأمین مالی می شود که در ژانویه سال قبل برای سرمایه گذاری در تحقیقات علمی بالقوه تحول آفرین افتتاح شد.

دیوید دالریمپل، مدیر برنامه هوش مصنوعی محافظت شده در ARIA می گوید هدف «هوش مصنوعی محافظت شده» ساخت سیستم های هوش مصنوعی است که می توانند تضمین های کمی در مورد تاثیر آنها بر دنیای واقعی عرضه کنند. ایده اینست که آزمایش انسانی را با تحلیل و بررسی ریاضی پتانسیل صدمه رسانی سیستم های جدید تکمیل کند.

هدف این پروژه ساخت مکانیسم های ایمنی هوش مصنوعی با ترکیب مدلهای علمی جهان است که اساسا شبیه سازی هایی از جهان با اثبات های ریاضی هستند. این شواهد شامل توضیحاتی در رابطه با کار هوش مصنوعی می شود و انسان ها وظیفه دارند بررسی نمایند که آیا بررسی های ایمنی مدل هوش مصنوعی درست است یا خیر.

بنجیو می گوید که می خواهد کمک نماید تا این اطمینان حاصل شود که سیستم های هوش مصنوعی آینده نتوانند صدمه جدی وارد کنند.

وی ادامه داد: ما هم اکنون درحال حرکت در مسیری مه آلود هستیم که امکان دارد یک پرتگاه پیش رویمان باشد. ما نمی دانیم که پرتگاه چقدر دور یا نزدیک است یا حتی اصلا پرتگاهی وجود دارد یا نه. ازاین رو امکان دارد سال ها یا دهه ها زمان ببرد و نمی دانیم که چقدر می تواند جدی باشد. ما باید ابزارهایی را برای پاک کردن آن مه ایجاد نماییم و مطمئن شویم که اگر پرتگاهی وجود دارد به درون آن سقوط نکنیم.

بنجیو می گوید، شرکتهای علم و فناوری راهی برای عرضه تضمین های ریاضی بر مبنای این که سیستم های هوش مصنوعی مطابق برنامه ریزی رفتار خواهند کرد، ندارند. او می گوید که این غیرقابل اعتماد بودن می تواند به نتایج فاجعه باری منجر شود.

دالریمپل و بنجیو استدلال می کنند که روشهای فنی فعلی برای کاهش خطر سیستم های هوش مصنوعی پیشرفته که در آن افراد سیستم های هوش مصنوعی را برای یافتن نقص ها بررسی می کنند، محدودیت های جدی دارند و نمی توان برای اطمینان از عدم کارکرد سیستم های حیاتی به آنها اعتماد کرد.

در عوض آنها امیدوارند که این برنامه راه های جدیدی را برای ایمن کردن سیستم های هوش مصنوعی عرضه نماید که کمتر به تلاشهای انسانی و بیشتر بر اطمینان ریاضی متکی باشند.

چشم انداز ساخت یک «هوش مصنوعی دروازه بان» است که وظیفه آن درک و کاهش خطرات ایمنی سایر عوامل هوش مصنوعی است. این دروازه بان تضمین می نماید که عوامل هوش مصنوعی که در قسمت های پرمخاطره مانند سیستم های حمل و نقل یا انرژی کار می کنند، همانطور که ما می خواهیم عمل کنند.

دالریمپل می گوید ایده اینست که در ابتدا با شرکت ها همکاری نماییم تا بفهمیم که مکانیسم های ایمنی هوش مصنوعی چگونه می توانند برای بخش های مختلف مفید باشند.

بنجیو استدلال می کند که پیچیدگی سیستم های پیشرفته به این مفهوم است که ما چاره ای جز استفاده از هوش مصنوعی برای حفاظت از هوش مصنوعی نداریم. این تنها راه است، چونکه در بعضی مواقع این هوش مصنوعی ها بسیار پیچیده هستند. حتی آنهایی که حالا داریم.

مرحله بعدی ساخت مدل هایی است که می توانند سیستم های هوش مصنوعی دیگر را بررسی نمایند. همینطور پروژه هوش مصنوعی محافظت شده و ARIA امیدوارند وضع موجود صنعت هوش مصنوعی را تغییر دهند.

ARIA همینطور به افراد یا سازمان ها در قسمت های پرخطر مانند حمل و نقل، مخابرات، زنجیره تأمین و تحقیقات پزشکی کمک مالی می کند تا به آنها کمک نماید تا برنامه هایی بسازند که امکان دارد از مکانیسم های ایمنی هوش مصنوعی بهره مند شوند.

این سازمان در مجموع ۵.۴ میلیون پوند در سال اول و ۸.۲ میلیون پوند دیگر در سال بعد به متقاضیان عرضه می دهد و آخرین فرصت ارسال درخواست ها تا دوم اکتبر است.

این آژانس همینطور شبکه گسترده ای را برای افرادی که امکان دارد علاقمند به ساخت مکانیسم ایمنی Safeguarded AI از راه یک سازمان غیرانتفاعی باشند، بوجود می آورد.

دالریمپل می گوید که این برنامه به دنبال پیشنهادهایی جهت راه اندازی یک سازمان غیرانتفاعی با هیئت مدیره متنوع است که بخش های مختلف زیادی را در بر گیرد تا این کار را به روشی قابل اعتماد انجام دهد. این مشابه همان کاری است که شرکت اوپن ای آی(OpenAI) در ابتدا برای انجام آن پیش از تغییر استراتژی خود برای محصول محوری و سود بیشتر افتتاح شد.

هیئت مدیره این سازمان فقط مسئول پاسخگو کردن مدیر عامل نخواهد بود، بلکه حتی بر تصمیم گیری ها در مورد انجام پروژه های تحقیقاتی خاص و انتشار مقالات و APIهای خاص تاثیر می گذارد.

پروژه «هوش مصنوعی حفاظت شده» بخشی از مأموریت بریتانیا برای مطرح کردن خود بعنوان یک پیشگام در حوزه ایمنی هوش مصنوعی است. این کشور در نوامبر ۲۰۲۳ میزبان نخستین اجلاس ایمنی هوش مصنوعی بود که رهبران و فناوران جهان را گردهم آورد تا در رابطه با چگونگی توسعه این فناوری به روشی ایمن بحث کنند.

دالریمپل می گوید در حالیکه برنامه تأمین مالی برای متقاضیان مستقر در بریتانیا اولویت دارد، ARIA به دنبال استعدادهای جهانی است که امکان دارد علاقمند به آمدن به بریتانیا باشند.

آژانس ARIA همینطور دارای یک مکانیسم مالکیت معنوی برای تأمین مالی شرکتهای انتفاعی در خارج از کشور است.

بنجیو می گوید، برای ارتقای همکاری بین المللی در زمینه ایمنی هوش مصنوعی به این پروژه جذب شده است. او ریاست گزارش علمی بین المللی در مورد ایمنی هوش مصنوعی پیشرفته را هم بر عهده دارد که شامل ۳۰ کشور و همینطور اتحادیه اروپا و سازمان ملل می شود. او که مدافع سرسخت ایمنی هوش مصنوعی است، بخشی از یک لابی تأثیرگذار بوده است که اخطار می دهد هوش مصنوعی فوق هوشمند یک خطرِ وجودی دارد.

بنجیو می گوید: ما باید بحث در مورد چگونگی مقابله با خطرات هوش مصنوعی را به مجموعه ای جهانی و بزرگتر بیاوریم و این برنامه ما را به این هدف نزدیکتر می کند.

منبع: سرگرمی كامپیوتری

این مطلب را می پسندید؟

(0)

(0)

تازه ترین مطالب مرتبط

نظرات بینندگان در مورد این مطلب